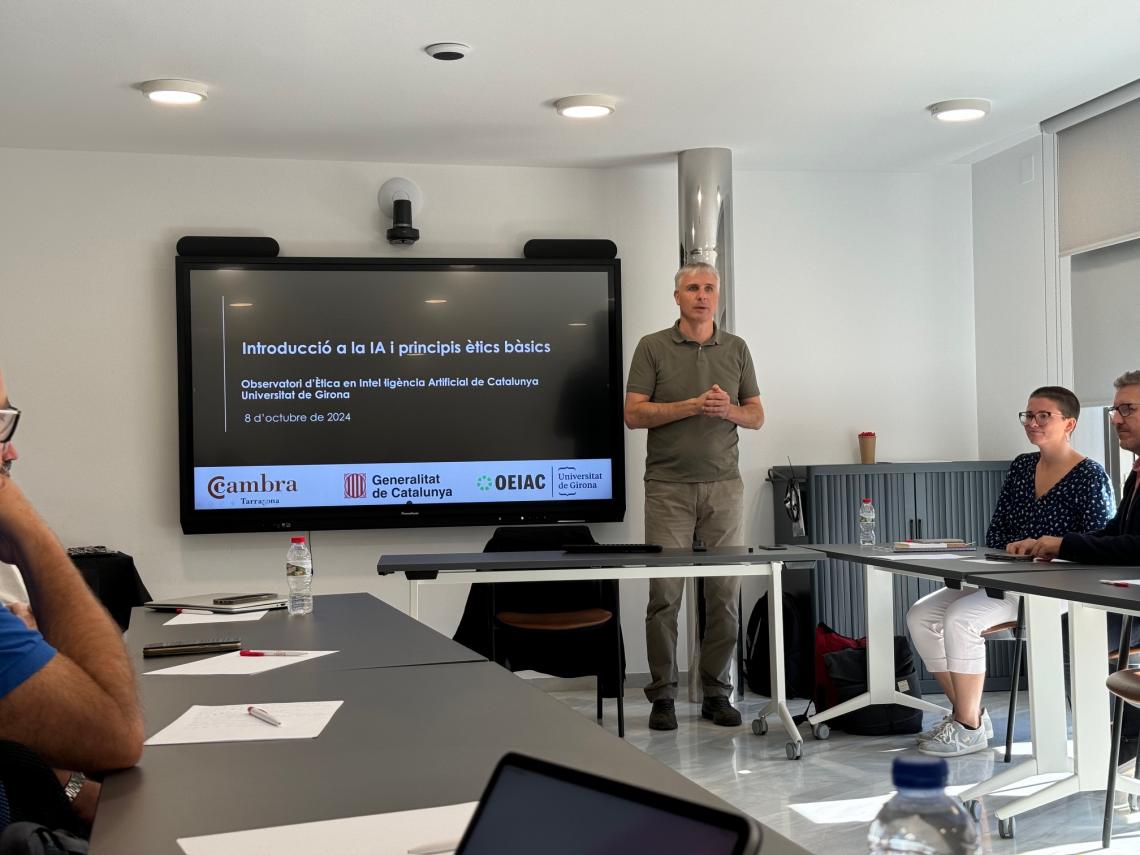

Albert Sabater Coll, professor de la Universitat de Girona i director de l'Observatori d'Ètica en Intel·ligència Artificial de Catalunya ha parlat a la Cambra de Tarragona de l’ús ètic de la intel·ligència artificial. I ho ha fet en el marc d’una jornada d’ebusiness.

L’objectiu de la sessió ha estat facilitar eines per fer una avaluació ètica de dades i sistemes d’intel·ligència artificial de la teva empresa. Per dur a terme aquesta avaluació s’ha emprat el Model PIO, Principis, Indicadors i Observables, una eina de verificació pionera desenvolupada per l'Observatori d'Ètica en Intel·ligència Artificial de Catalunya, Oeiac, que fomenta el progrés tecnològic a través de les coordenades d'una IA responsable i mitjançant el compliment dels requisits legals a la llum de la Llei d'Intel·ligència Artificial de la UE o Al Act.

Aquest programa de formació i capacitació tècnica s’ha inserit en el marc de l’Estratègia d’Intel·ligència Artificial de Catalunya, Catalonia.AI, del qual l’Oeiac, ubicat a la Facultat de Ciències Econòmiques i Empresarials de la Universitat de Girona, n’és un dels pilars conjuntament amb el CIDAI, AIRA i la DCA.

De què s’ha parlat:

Introducció a la IA i principis ètics

Introducció als conceptes de la IA, que cobreix l'aprenentatge automàtic, les xarxes neuronals i el processament del llenguatge natural, destacant la complexitat i el potencial de conseqüències no desitjades en els sistemes de la IA.

Consideracions ètiques en IA, abordant qüestions com la parcialitat, l'equitat, la transparència i la responsabilitat, alineades amb els principis ètics descrits al Model PIO.

Marcs legals i compliment, amb el focus en la AI Act

Visió general de la Llei de la IA de la UE, amb una panoràmica sobre la comprensió bàsica de les disposicions clau de la normativa, incloses les definicions, l'abast i els objectius.

Visió específica basada en el risc, per comprendre la classificació de la Llei de la IA de la UE, basada en el risc dels sistemes d'intel·ligència artificial (risc inacceptable, risc elevat, risc limitat, risc mínim), que destaca el compliment i la responsabilitat legal.

Aplicació pràctica de models d'avaluació. Model PIO

Introducció al Model PIO, per entendre una estructura d’avaluació d’usos ètics i legals de dades i sistemes d’IA tenint en compte necessitats generals i específiques de diferents organitzacions públiques i privades.

Capacitació en tècniques de preavaluació i avaluació d’usos ètics i legals de dades i sistemes d’IA, a través d’un sistema de contestació que permet abordar una primera anàlisi de dades i sistemes així com les seves possibles conseqüències ètiques, socials i legals.